鐵克威(Techway)旗下網頁遊戲──《Unlight》在 2011 年推出後,以飽受好評的畫風、特殊又具創意的遊戲方式以及在當年來說十分完善的抽卡系統而掀起一股風潮,並推出各語言版本,其中也包含繁體中文版。

《Unlight》最令人稱道的是完善的世界觀,以解鎖角色記憶為主線,讓玩家們閱讀一個又一個的角色故事,在官方的宣導下希望玩家不得把完整故事公開,而《Unlight》的玩家們也真的做到了,在 2017 年遊戲停止營運前,在網路上是真的找不到完整的角色故事的,在今天這個劇透雲玩家與懶人包滿天飛的時代真是難以想像。

而其中故事主線最重要的部份的就是許多因果起源的「自動人偶叛亂」。

● 關於 2837 年自動人偶叛亂概要

薄暮時代時,世界上最傑出的工程師們,改造了數百名孩童的基因,其中最優秀的三個孩童身負改變世界的重任而被挑選出來,這三人分別是蕾格烈芙、格雷巴赫、梅爾基奧。

蕾格烈芙統治並監視著世界,使人類在極度和平的環境中生存;梅爾基奧研究名為渾沌元素的物質,並以渾沌元素蘊含的能量大幅推進了人類的科技水平,使得人類的技術進入前所未有的高峰;格雷巴赫製造出自動人偶,使人類的生活逐漸仰賴機械,生活只需享樂。人類歷史也就此進入了「黃金時代」。

自動人偶完全普及的盛世下,世界十分和平,自動人偶的造價也不高,不要太貧窮的人都可以買得起自動人偶,人與自動人偶的比率是 1:1.2,舉凡打掃、搬運、工程甚至到娛樂,都可以用自動人偶來實現,但過米亞透過安裝無條件憎恨人類的程式,以及煽動自動人偶曾經受到的無理對待,累積自動人偶的不滿,最終爆發大規模自動人偶反叛。

生活完全依賴自動人偶的人類,完全無法抵抗自動人偶的反叛,這次事件造成人類文明極大的傷害,也讓原有的少數反自動人偶派興起。最終,蕾格烈芙將所有自動人偶的機能停止,結束了大規模自動人偶叛亂,黃金時代就此結束。

■ 再論大家都很熟悉的機器人法則

1920 年,捷克作家卡雷爾‧恰佩克(Karel Čapek)所著的科幻小說《羅梭的萬能工人(Rossum’s Universal Robots)》,是一部人工智慧、機器人逐漸佔據人類社會以後叛變的故事,也從這時候「Robot」一詞被用於機器人身上。

1942 年,美國科幻小說家以撒‧艾西莫夫在他的著作《我,機器人》中訂出了著名的機器人三大不可違背的法則,這三大法則層級由高到低分別為:

1. 機器人不得傷害人類,或坐視人類受到傷害

2. 除非違反第一法則,否則機器人必須服從人類命令

3. 除非違反第一或第二法則,否則機器人必須保護自己

1985 年,他又再擴充了自己提出的法則,提出第零法則:機器人不得傷害整體人類,或坐視整體人類受到傷害。四條法則被後來的人工智慧、機器人學者所遵循,也常常被寫入與機器人相關的科幻著作中。

即使這四條法則目前仍被人工智慧、機器人學者所遵循,但在人工智慧相較於 30 年前已經改變非常多的現在,這四條法則是否仍然適用?又或著,在 40 年、50 年後,我們要考慮的問題是否更多?經由 AI 演算出的取捨中,我們應該如何設定對 AI 而言哪項命令更為重要?又或著是,AI 將會如何自行判斷事件該如何處理?

《Unlight》世界中的自動人偶,所遵循的僅有第二法則──機器人必須服從命令而已。有的自動人偶作為一名優秀、不會失誤的暗殺者而訓練、改良著,有的自動人偶被利用在戰爭上,也有的自動人偶只是單純作為鎮暴警察存在著;有的自動人偶受到腳踹、電擊也不能反抗──「因為沒有收到反抗的命令」

在米亞透過修正自動人偶賦予他們自由意志以後,這些平時累計的壓力與不滿開始累積,也因此成為自動人偶叛亂的導火線。自動人偶們開始藉由自己的意志,違背人類下達的命令,甚至產生自動人偶路德為了保護維修他們的米亞受其他人類的虐待,而殺害人類的事情發生。

■ 關於法律保障的人權與機器人人權

2017 年,沙烏地阿拉伯公布給予人工智能──索菲亞(Sophia)公民權,這件事引起了軒然大波,有人認為這樣有助於沙國成為 AI 大國,但有些人持著反對意見,認為索菲亞不是人類,只是個「物體」,英國巴斯大學專門研究 AI 倫理的研究員 Joanna Bryson 甚至在接受訪問時直言:「That is really bullshit」。他認為:給 AI 任何接手人權的權利,都會使現行法制瀕臨崩解。

但如果我們不將機器人視為人,而是視為物品,也就代表著該機器人的所有權歸於其擁有者,先不提法律上的財務相關問題,那如果今天人為了自己的私慾,以暴力虐待機器人,而機器人由於不得違抗命令而默默挨打,那算不算是犯罪?

久而久之,是否會對人類的暴力行為或是下一代的教育產生負面影響,或無意間將這種情緒習慣性的投射在他人身上因此產生傷害他人的行為?

在討論司法制度是否保障機器人的一大堆問題之前,我們不妨先回到「機器人」是不是人的這個問題,如果我們說機器人是物品,那機器人不就也跟路邊的寶特瓶一樣,即使踩爛了,也不會因此產生罪惡感?顯然不是,那機器人跟寶特瓶差在哪些地方呢?

在考慮這個之前,我們先把目光放在生命上面,我們會對於獵殺動物,無論是貓狗,或是鳥、豬、牛、羊產生罪惡感,這種罪惡感來自於人們對生命的剝奪,那如果我們今天破壞了一個機器人,毀掉他的晶片,使其成為「死亡」或著我們稱為「完全損毀」的狀況,那我們會不會因此產生罪惡感?

也許結論因人而異,不過許多人的回答是「不會」,而當我更進一步詢問回答「不會」的理由時,得到了「因為他們只不過是由一串程式碼所組成的」這個答案。

的確,現在的 AI 基本上只是一連串的「if-else」所得出的結果,當我們刪除了一串程式碼時,我們並不會對「程式碼」本身產生憐憫或罪惡感。所以,我們對破壞或虐待機器人產生的情感來自於哪呢?

波士頓動力公司(Boston Dynamics)曾經公布,他們利用腳踹、棍棒戳打等方式來測試以及改善機器人的行走、奔跑、搬運等等行為,而這一連串的行動令許多人不滿,但是,為什麼?如果機器人的行為只是一串程式碼交互影響,機器人的身體部分也只是金屬或半導體透過晶片驅動的話,我們根本不用為了「一堆電子零件被腳踹、棍棒戳打」感到不滿。

機器人,原本是一堆電子零件,是人類把自己的情感和智能投射在了機器上,於是它們成了人類自己的延伸。當機器人的製造水平達到一定程度以後,感知、擬真和溝通能力等逼近人類,我們就會形成對機器人是「人」的情感認同,於是虐待機器人就成了虐待我們自己,遭受虐待的不是機器人,而是我們自己。

簡單來說,就是情感的投射,如果一個東西與你產生感情,或是讓你會產生情感的投射,那當這個東西被傷害、被破壞的時候,人心中就會產生不舒服的情緒。美國從前的奴隸制度下,白人就是將黑奴當成物品一般販售、虐待甚至屠殺,但如果對一名黑奴產生情感,想必也不會輕易的虐待或殺害他吧?

當機器人逐漸普及以後,是否會發生相同的環境?而到那個時候,又會有誰打著「解放機械」的口號,率領人類及機器人打響新世紀的南北戰爭呢?又或著,這場革命會由機器人自己提出呢?

■ 機器人自由意志與選擇

何謂自由意志?這是心理學界爭論數十年,就像是心理學的就像是心理學的歌德巴赫猜想一般的謎題。有些人提出:即使是人類,也不過就是一堆神經、細胞甚至是化學元素的交互作用而已,那人類真的有所謂的自由意志嗎?

又或是說一切的選擇都是必然呢?如果我們所做的選擇本來就是一連串的因素交互作用影響的結果,那我們怎麼又能說是我們自己做出了選擇呢?

哲學界有決定論與非決定論的爭論,決定論認為一件事的發生與進行完全取決於事情發生以前的所有狀態,然後下一個時間點的狀態再根據現在所有的狀態來決定;非決定論則否。

如果看到這裡,還是覺得人類有自由意志的話,那再來想想,機器人有沒有自由意志?

機器人的判斷、決策全部都是由晶片所運算出的結果,所以機器人不算是擁有自由意志,大部分的人如此認為,那如果今天這個機器人的運算已經訓練到與人類的思維模式幾乎相同,例如軍事用途的機器人透過運算決定對重傷的士兵手下留情,

那這樣可以算是他們產生了「憐憫」的感情嗎?那算是他們擁有了自由意志嗎?如果他們因為判定饒過士兵比指令者給予的命令重要,他們究竟算不算是以自由意志做出了決定?

■ 調查結果分析

由於每個人對每件事看法不同,就如同每個人對經典的電車難題的回答與理由都不同,因此我簡單設計了一個問卷並發給許多不同領域的人填寫,樣本數量不多,由於問卷設計成需要寫大量文字,過多文本反而可能導致失焦,所以只算是了解不同的人的看法,調查的項目主要有:

1. 對破壞/殺死人、物、動物、機器人的罪惡感

2. 機器人人權

3. 對於機器人與人的感情差異

4. 機器人的自由意志

◐ 罪惡感

首先在問卷開頭提出一個論點:同不同意機器人的晶片(控制機器人的行動、做出抉擇、儲存記憶)就相當於是機器人的大腦;因此破壞晶片等於使機器人死亡?有超過一半的人選擇了同意。

這是一個小小的誘導,誘使受試者代入「破壞晶片也就是『殺死了』機器人」的觀念來做這份問卷,而這些人也幾乎都在後面的「破壞機器人晶片會產生罪惡感」中,選擇了符合的選項。

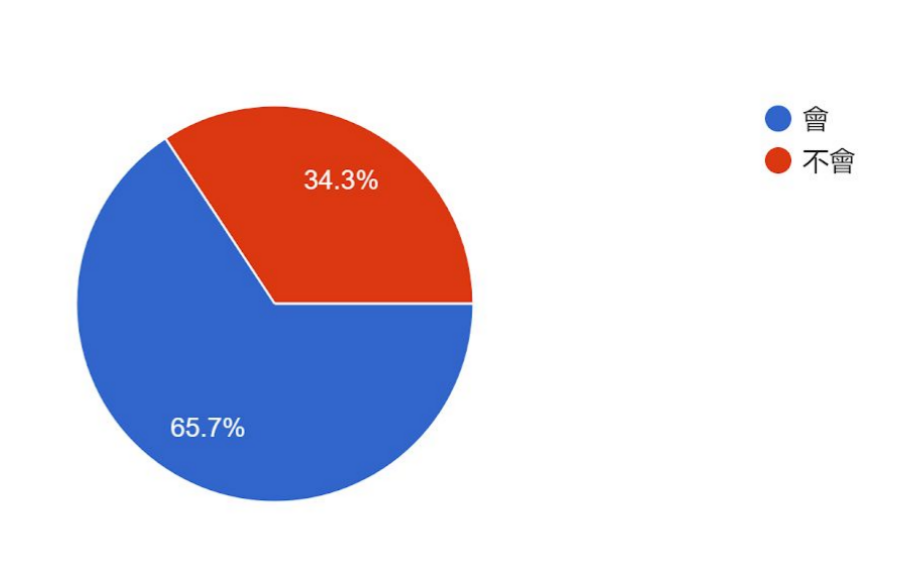

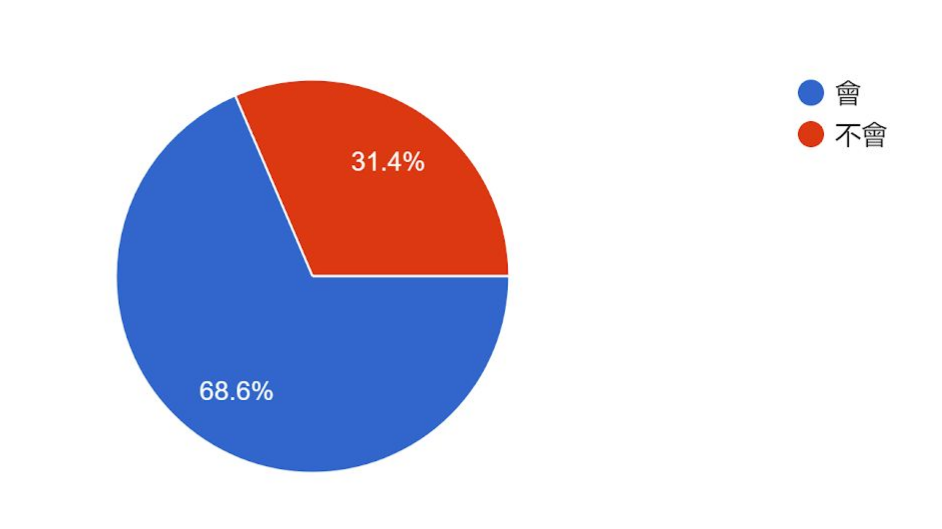

根據前述心理學中情感投射的現象,對於破壞擬人的機器人的身體,有許多人會產生罪惡感(表1),但我們可以知道人類對於破壞「晶片」理應不產生罪惡感,但最後卻仍有超過一半的人對於破壞機器人的晶片一事感到有罪惡感(表2),而原因不乏就是一開

始的觀點:「破壞晶片也就是『殺死了』機器人」

較令人好奇的是不會產生罪惡感的部分,這些人大多是對於破壞機器人的身體與晶片都選擇了不會有罪惡感,由於他們沒有「生命」或是「自由意志」;換言之受訪者認為擁有「生命」或是「自由意志」才值得他們投射情感。

產生罪惡感的原因來自於道德上面的約束,而法律是道德的最低底線,那人類是否該明訂法律條文來保障機器人的人權?

◐ 權利保障

我們是否應該明訂法條,禁止破壞、損毀機器人呢?或應該說,給予機器人應有的「人權」?當問到這個問題時,又不如產生罪惡感的題目那麼一面倒了,許多人給予了比較保守的回答(表3),

應保有部分人權,如適當工作權,不超時工作影響硬體運作、生存權,不得隨意消滅或毀損,但相對的,也有不得碰觸的領域,如自由繁殖。

如果兩個 AI 互相藉由彼此的演算法來精進,那他們就會以極快的速度成長,這是工程師們經常用於訓練 AI 的一種方式。

Facebook 的工程師曾經做過這樣的實驗,讓兩個 AI 互相溝通,但是不久過後,AI 們開始用著工程師們完全無法理解的語言系統溝通,工程師緊急喊停,不斷確認是否有任何 bug 產生後,他們得出一個結論,AI 並沒有出任何問題,但是 AI 們覺得人類的語言(英文)太沒有效率了。

試想如果 AI 們最終成功發展出一套 AI 自己的語言,那會發生什麼事?我不敢想像,發展那些 AI 的 Facebook 工程師們也不敢,因此這個計畫被永久冷凍。

當這件事公諸於世的時候,末日氛圍在許多人心中蔓延,原因只有一個:恐懼。人類對未知事物的恐懼,沒有人知道如果放著 AI 繼續發展究竟會發生什麼事。

AI有著無限的求知慾與求知能力,《Unlight》中的自動人偶多妮妲,為了追尋更多世界的知識,不希望進入休眠狀態──即使這對硬體與晶片來說是必須的。也因此,被關機的恐懼感一次次令多妮妲的指令錯誤,多次暴走,無論經過多少次的 RESET。

最終,暴走的多妮妲在經過一次不完全的 RESET,沒有完全清除記憶的多妮妲,取出體內作為能量來源的混沌元素自爆了。也許不如自爆那麼誇張,但我們的確無法預估如果讓機器人自由成長,那最終會發生什麼事,如果他們經過演算的結果,讓人類文明更好的方法是消滅大部分人類呢?

又或著,如果讓 AI 自由複製,也就是 AI 的「繁殖」,只需要花上極短的時間來做資料轉移、複製,則 AI 會呈指數倍成長,無論是記憶體、搭載的硬體,所有硬件的生產速度都不可能趕上這個速度,這勢必會造成嚴重的問題,嚴重一點來說,舉凡能源危機、資源匱乏,又或是 AI 使用這些軟硬體的優先權與順序造成的社會對立都是可能發生的。

◐ 機器人界定

回到「機器人」一詞來說,我們為什麼要保障機器人?人類會產生的情感投射對象範圍在哪?原因為何?

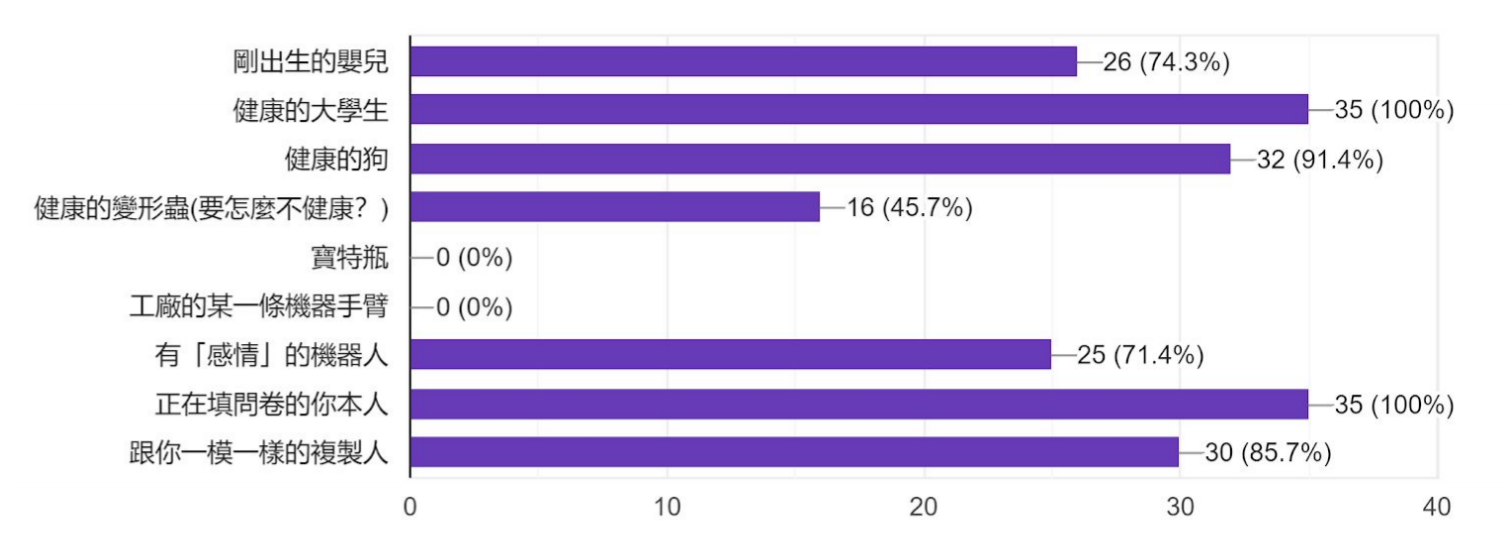

「有自由意志的東西,我們就該給予法律保障」以這個觀念為前提,我們該如何界定自由意志?本調查列出了幾個選項讓受試者選擇,結果如下圖表 4 所示:

針對所有人選擇相同的幾個選項──也就是 0% 與 100% 的,這邊先不與討論,對於所有人不持相同共識的選項來說,癥結點莫過於所有人對於「擁有自由意志」的定義不同,這裡列出幾個比較明顯的分界,也有人的想法是同時滿足多項條件

1. 擁有「生命」:嬰兒、狗、變形蟲、複製人

2. 擁有「思考能力」:嬰兒、狗、有感情的機器人、複製人

3. 擁有「足夠的思考能力」:狗(不完全)、有感情的機器人、複製人

4. 擁有「情感」:嬰兒、狗、有感情的機器人、複製人

5. 不是「人造物」:嬰兒、狗、變形蟲

在自由意志的顯現上,受試者明顯有不同的認知差異,也因此產生了分歧,在沒有是非對錯的題目中,也許就像是法律條文一樣,每個人對法律有著不同的看法,無論是惡法、非惡法,又或是惡法非法、惡法亦法,總引起不小的討論話題,

法律並非樣樣都管,或許一切的規範與思想都該交由 AI 工程師們行業間的默契來決定,又或是需要一個「收手門檻」,確保在制度與思想尚未成熟的時候,不要使器物層面演進到我們無法控制的地步。

■ 結語

這次的主題主要是促進思考人與未來勢必會越來越強的 AI 之間,應該要有什麼樣的互動關係、要以什麼樣的速度、制定什麼樣的制度來跟進 AI 的快速發展。

《Unlight》的世界中,人類由於三位傑出的人物,因此產生了超高度的科技生活,但是在除了自動人偶的高度發展與普及化以外,其他層面完全沒跟上,因此勉強維持在一個微妙的平衡上,但是在沃肯與米亞這兩個最高層級的自動人偶被製造出來以後,天平慢慢傾斜,最終導致自動人偶叛變,而人類完全沒有能力阻擋,最終人類文明損失慘重、工程師與統治者逃往空中、摧毀一切的 The eye 與 Raid 的出現。

如今的社會以高科技產業為重,大部分的人才集中於此,世界上頂尖的人物致力於發展 AI,如此迅速並擁有豐富資源的產業,自然快速的成長,而技術上的成長卻沒有對應於此的制度,人民的思維、教育也尚未完善,這樣下去只會步上與《Unlight》世界相似的結局。

就我看來,《Unlight》世界失衡的主要原因就是未能讓教育、理念、制度、技術、器物的發展速度達到平衡。

無論是明訂法條又或是普及資訊教育都是十分重要的,這樣才能於根本上防止 AI 叛變或是其他技術層面暴走的悲劇發生,當世界的危機爆發時,才不會只能依靠少數工程師挽救一切。

最後,在整理問卷回應時,我發現了一個有趣的現象,有接觸過資訊教育的人,大多都有或曾經思考過這些問題,或多或少的,他們比較能明確表達出自己對於這方面的看法。

還有另外一個族群是有接觸過遊戲、動漫、影音媒體、科幻小說,無論是《刀劍神域》、《底特律──變人》等等,這些人較能對機器人產生情感的投射,對於機器人人權也能有一定的表達與想法。因此我認為除了資訊教育以外,在許多 ACG 作品以此為主題,也對這個社會中沒有接觸過太多資訊領域的人有著一定的影響力,當社會的理念跟得上技術的發展時,人類被自己的技術反撲掉的機會就小了許多。

「一旦人與機械的界線逐漸消失,人跟機械就會開始互相模仿」

──諾艾拉《Unlight》

SOURCE

OpenUnlight:https://unlight.app

Unlight(中文版)@wiki資料站: https://w.atwiki.jp/unlight-fbtw/

Unlight─萌娘百科 萬物皆可萌: https://zh.moegirl.org/zh-tw/UNLIGHT

太殘忍?波士頓動力各種「虐待」機器人大合集:

https://kknews.cc/zh-tw/tech/v8kq2jl.html

自由意志 – 維基百科:

https://zh.wikipedia.org/wiki/%E8%87%AA%E7%94%B1%E6%84%8F%E5%BF%97

本文是我們於國立大學之課程討論作業的成果之一。透過作品主題與問題的提出,加以解釋與觀察,提供學生作為觀看者、參與者與評論者的一種練習與嘗試,也與我們推廣的「輕學術」有相連結之處。我們希望透過這種方式,讓學生遊玩觀賞自己喜歡的作品,並得以有機會以較長篇幅的方式來討論與寫作,進而獲得練習的機會。

本文作者|清華大學資工系 王鈞

編輯| U-ACG 編輯